2025年9月24日、杭州にて「2025 APSARAコンファレンス」が開催された。アリババグループCEOおよび阿里雲智能集団董事長兼CEOの呉泳銘(Wu Yongming)氏は大会で、アリクラウド(Alicloud)がフルスタックAI体系を大幅にアップグレードし、人工知能(AI)モデルからAIインフラストラクチャに至る技術更新を実現したと発表した。新たな智能革命の波に向け、アリクラウドはフルスタック人工知能サービスプロバイダーとなることを目指す。

呉氏は、汎用人工知能(AGI)の実現はすでに確定的な結果であるが、それは出発点に過ぎず、最終目標は自己革新が可能で人類を全面的に超越する超人工知能(ASI)を発展させることにあると述べた。

呉氏はASIへの3つの段階的進化ロードマップを以下のように説明した。

第一段階:「智能の創発」。AIが膨大な人類の知識を学習することで汎化智能を備える段階。

第二段階:「自主行動」。AIがツールの使用とプログラミング能力を習得し、「人間を補助する」段階。これは業界が現在置かれている段階である。

第三段階:「自己革新」。AIが物理世界と接続し自己学習を実現することで、最終的に「人間を超越する」段階。

これに基づき、呉氏は、人工知能時代においてAIモデルは次世代のオペレーティングシステムとなり、スーパーAIクラウドは次世代のコンピューターとなるとの見解を示した。スーパーAIクラウドには超大規模なインフラストラクチャとフルスタックの技術蓄積が必要であり、将来的には世界に5~6つのスーパークラウドコンピューティングプラットフォームしか存在しない可能性があると述べた。

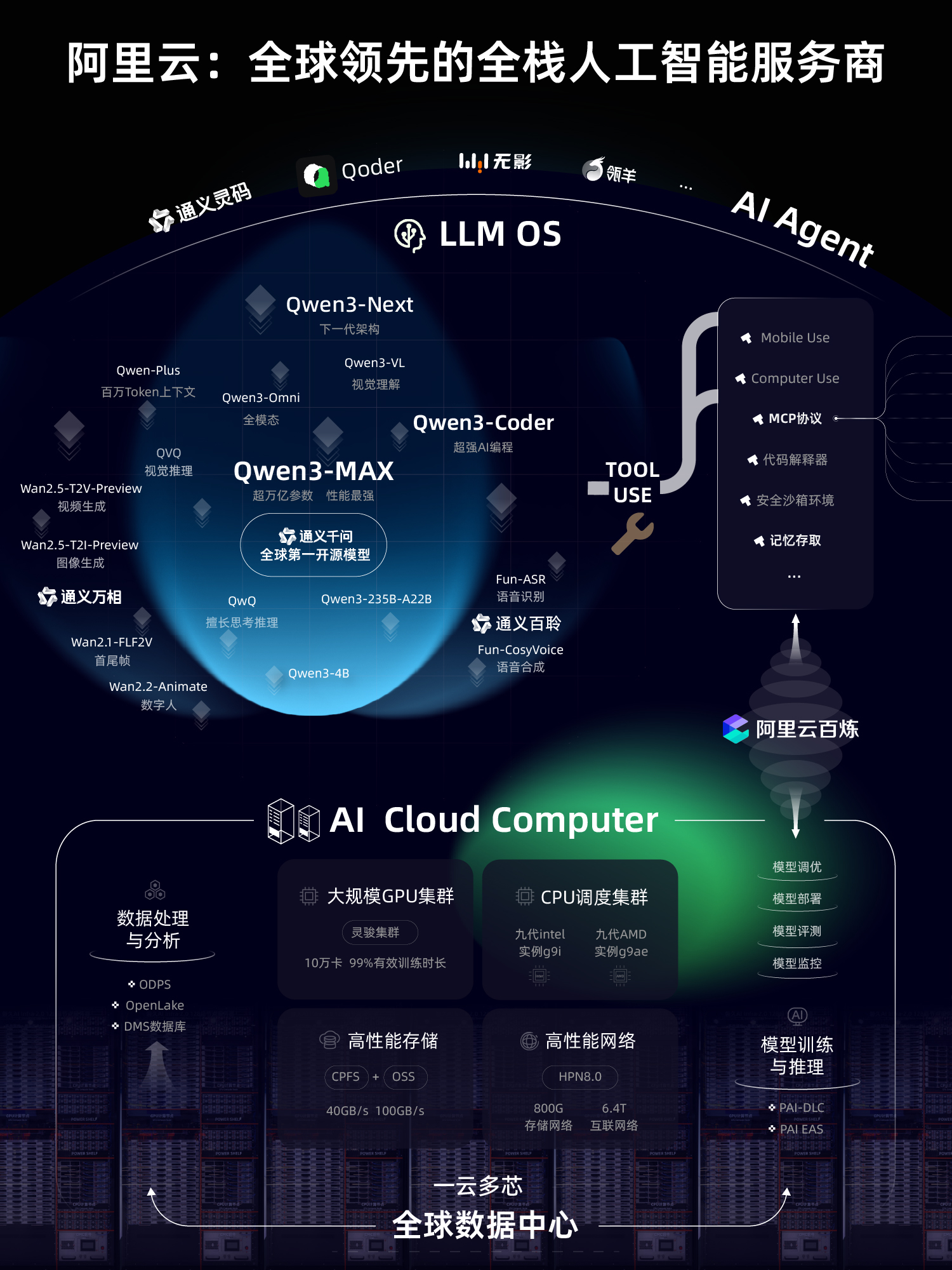

フルスタック人工知能サービスプロバイダーとなる目標を実現するため、呉氏はアリクラウドの戦略的パスを明確にした。第一に、「通義千問(Qwen)」はオープンソース化路線を堅持し、「AI時代のAndroid」の構築に注力する。第二に、「次世代コンピューター」であるスーパーAIクラウドを構築し、超大規模クラスターや高密度AIサーバーなどのインフラストラクチャを整備し、世界に智能計算能力ネットワークを提供する。

アリババの予測によれば、ASI時代の到来に備え、GenAIの元年である2022年と比較し、2032年におけるアリクラウドのグローバルデータセンターのエネルギー消費規模は10倍に拡大する見込みである。これは、アリクラウドの計算能力への投資が指数関数的に増加することを意味する。

このため、アリババは今後3年間でクラウドおよびAIハードウェアインフラストラクチャ建設に3800億元(約7.6兆円)以上を投資する計画を積極的に推進している。この金額は、中国の民間企業における同分野への投資額として過去最大を記録し、総額は過去10年間の合計をも上回る。

AIモデルを7つ連続発表、旗艦モデルQwen3-Maxの性能がGPT-5を超越

AIモデルとAIクラウドに関連し、2025 APSARAコンファレンスで阿里雲智能集団CTOの周靖人(Zhou Jingren)氏が複数の重要な技術更新を発表した。「通義」系列のAIモデルが7つ連続で発表され、モデルの智能レベル、Agentのツール呼び出しとコーディング能力、深層推論、マルチモーダルなどにおいて数多くの突破を実現した。

大規模言語モデル(LLM)では、アリババの「通義」旗艦モデル「Qwen3-Max」が新たに登場し、その性能はGPT-5やClaude Opus 4などを上回り、世界トップ3にランクインした。Qwen3-Maxは指示(Instruct)版と推論(Thinking)版の二つのバージョンを含み、そのプレビュー版はすでにChatbot Arenaランキングで3位につけており、正式版ではさらなる性能突破が期待される。

Qwen3-Maxは「通義千問」ファミリーで最大かつ最強の基盤モデルであり、事前学習データ量は36トークン、総パラメータ数は1兆を超え、極めて強力なコーディング能力とエージェントのツール呼び出し能力を有する。AIモデルがコーディングで現実世界の問題を解決する能力を測るSWE-Bench Verifiedテストでは、Instruct版が69.6点を獲得し世界トップクラスとなった。Agentのツール呼び出し能力に焦点を当てたTau2-Benchテストでは、Qwen3-Maxは画期的な74.8点を達成し、Claude Opus4とDeepSeek-V3.1を上回った。Qwen3-Max推論モデルも非凡な性能を示し、ツール呼び出しと並列推論技術を組み合わせることで、その推論能力は新たな高みに達した。特に数学的推論に焦点を当てたAIME 25とHMMTテストでは、いずれも画期的な満点100点を達成し、中国国内では初めてのことだ。

同時に、次世代基盤モデルアーキテクチャ「Qwen3-Next」及びシリーズモデルが正式にリリースされた。総パラメータ800億のうち30億のみを活性化するだけで、千問3旗艦版の2350億パラメータモデルに匹敵する性能を実現し、モデル計算効率において重大な突破を果たした。

専門特化モデルでは、コーディングモデル「Qwen3-Coder」が大幅にアップグレードされた。新しいQwen3-CoderはQwen Code、Claude Codeシステムと共同で訓練され、応用効果が显著に向上し、推論速度が速くなり、コードの安全性も大幅に高められている。

マルチモーダルモデルでは、期待の高かった視覚理解モデル「Qwen3-VL」がオープンソース化され、視覚知覚とマルチモーダル推論において重大な突破を実現、32の核心能力評価においてGemini-2.5-ProとGPT-5を上回った。Qwen3-VLは極めて強力な視覚エージェントと視覚コーディング能力を有し、画像を理解できるだけでなく、人間のようにスマートフォンやパソコンを操作し、多くの日常業務を自動化できる。

フルモーダルモデルでは、「Qwen3-Omni」がサプライズ登場した。音声・動画能力において32のオープンソース最高性能(SOTA)を獲得し、人間のように聞き、話し、書くことができ、車載、スマートグラス、スマートフォンなどへの展開が可能で、応用シーンは広い。ユーザーは個性に合わせた役割設定や会話スタイルの調整ができ、専属の個人IPを創出できる。

さらに、通義大モデルファミリーの視覚基盤モデル「通義万相(Wanxiang)」は「Wan2.5-preview」シリーズモデルを発表し、文章生成動画、画像生成動画、文章生成画像、画像編集の4つのモデルをカバーする。通義万相2.5動画生成モデルは、映像に合致する人声、音響効果、音楽BGMを生成でき、初めて音画同期の動画生成能力を実現し、映画級の動画創作のハードルをさらに引き下げた。

特筆すべきは、今回のAPSARAコンファレンスで新たな音声大モデル「通義百聆(Bailing)」が発表されたことである。これは音声認識大モデル「Fun-ASR」と音声合成大モデル「Fun-CosyVoice」を含む。Fun-ASRは数千万時間に及ぶ実音声データに基づき訓練され、強力な文脈理解能力と業界適応性を備える。Fun-CosyVoiceは100種類以上の预制音声を提供でき、カスタマーサービス、販売、ライブコマース、民生家電、オーディオブック、児童向けエンターテインメントなどのシーンに利用できる。現在、通義百聆オープンソースモデルのダウンロード数は5.6億回を超えている。

モデル日次呼び出し量が15倍に増加、アリクラウド百煉が新エージェント開発フレームワークを発表

ワンストップのモデルサービス及びエージェント開発プラットフォームである「アリクラウド百煉(Bailian)」も大幅なアップグレードを実施した。コンファレンスでは、アリクラウドが新エージェント開発フレームワーク「ModelStudio-ADK」を発表した。このフレームワークは、事前定義された編成方式でエージェントを開発する限界を突破し、企業が自律的な意思決定、複数回の内省、循環的な実行能力を備えたエージェントを効率的に開発することを可能にする。ModelStudio-ADKを使用すれば、1時間で深度リサーチレポートを生成できるDeep Researchプロジェクトを容易に開発できる。モデル能力の絶え間ない向上およびエージェント応用の急増に伴い、過去1年間でアリクラウド百煉プラットフォームのモデル日次呼び出し量は15倍に成長した。

コンファレンスでは、アリクラウド百煉はさらにローコードエージェント開発プラットフォーム「ModelStudio-ADP」をアップグレードした。このプラットフォームは金融、教育、Eコマースなどの分野の企業に広く活用されている。現在、アリクラウド百煉プラットフォームでは20万人以上の開発者によって80万以上のエージェントが開発されている。紹介によれば、網商銀行(MYbank)はModelStudio-ADPに基づき融資審査アプリケーションを開発し、契約書、インボイス、営業許可証など26種類の証憑、および店頭、厨房、飲食エリア、棚商品など400種類以上の細粒度物体の正確な識別をサポートし、正確率は95%を超え、タスク処理時間は従来の3時間から5分以内に短縮された。

同時に、アリクラウドのエージェントインフラの重要コンポーネントである「無影AgentBay」も大きなアップグレードを迎えた。無影AgentBayは、アリクラウドがエージェント向けに量身打造した「スーパーブレイン」であり、クラウド上の計算能力、ストレージ、ツールチェーンリソースを動的に呼び出し、ローカルデバイス上のエージェントの計算能力制限を大きく突破する。今回のAPSARAコンファレンスでは、無影AgentBayはさらに自己進化エンジン、カスタムイメージ、セキュリティフェンス、メモリ状態管理などの新機能を発表し、新たな個人向け計算製品「無影Agentic Computer」を初公開した。これは新たな人間とコンピューターのインタラクション方法、革命的な「記憶」能力、そしてほぼ無限のクラウド上の計算能力を備えている。

NVIDIAと連携し、物理AIを発展

アリババはAPSARAコンファレンスで、NVIDIAの「Physical AI」(物理人工知能)開発ソフトウェアスタックを統合し、自社のクラウドAIプラットフォーム「PAI」の能力を全面的に強化すると発表した。今回の提携は、データ合成処理、モデル訓練、環境シミュレーションを用いた強化学習、モデル検証とテストなど、全リンクにわたるサービスをカバーし、エンボディードAI(具身智能)のロボットや自動運転など多分野での応用加速を目指す。

今回の協業は、NVIDIAがリードするAIチップとソフトウェア技術を組み合わせ、AI分野をリードする両社の緊密な連携を促進し、企業顧客がPhysical AI関連アプリケーションをより迅速に開発・導入することを支援する。

AI計算能力が1年で5倍以上増加、アリクラウドのAIインフラが全面アップグレード

アリクラウドはAIを中心に、ソフトウェアとハードウェアのフルスタックにわたる協調的な最適化とシステム革新を進め、「通義」を核とするオペレーティングシステムと、AIクラウドを核とする次世代コンピューターの基盤を初步的に形成した。過去1年間で、アリクラウドのAI計算能力は5倍以上増加し、AIストレージ能力は4倍以上増加した。

2025年APSARAコンファレンスでは、全面アップグレードされたアリクラウドのAIインフラストラクチャが公開され、アリクラウドの基幹チップ、超ノードサーバー、高性能ネットワーク、分散ストレージ、AIコンピューティングクラスターから、AIプラットフォーム、モデル訓練・推論サービスに至るまでのフルスタックAI技術能力が展示された。

サーバー層面では、アリクラウドは新世代の「磐久128」超ノードAIサーバーを発表。この新世代磐久超ノードサーバーはアリクラウドが独自に開発・設計したもので、高密度、高性能、高可用性という核心的優位性を備え、多種多様なAIチップを効率的にサポートする。1キャビネットで128個のAI計算チップをサポートし、その密度は業界記録を更新した。

ネットワーク層面では、アリクラウドの新世代高性能ネットワーク「HPN 8.0」が登場。AIモデル時代の膨大なデータ転送需要に対応するため、HPN8.0は学習と推論を統合したアーキテクチャを採用し、ストレージネットワーク帯域幅を800Gbpsに、GPU相互接続ネットワーク帯域幅を6.4Tbpsに引き上げた。単一クラスターで10万基のGPUの効率的な相互接続をサポートし、1万基規模の大規模クラスターに高性能で確定的なクラウド基盤ネットワークを提供し、AIの学習と推論の効率化を支援する。

ストレージ層面では、アリクラウドの分散ストレージはAIの需要に応じて全面アップグレードされた。高性能並列ファイルストレージ「CPFS」の単一クライアントでのスループットは40GB/sに向上し、AI訓練がデータを高速に読み込むという極限の要求を満たす。テーブルストレージ「Tablestore」は、エージェント向けに高性能なメモリバンクとナレッジベースを提供。オブジェクトストレージ「OSS」は「Vector Bucket」を発表し、ベクトルデータ向けにコスト効率の高い大規模ストレージを提供する。自前で構築するオープンソースのベクトルデータベースと比較し、コストを95%急減させることができる。OSSの「MetaQuery」セマンティック検索とコンテンツ認識能力と組み合わせることで、RAGなどのAIアプリケーションを迅速に構築可能。

AIコンピューティングクラスター層面では、智能計算「霊駿」クラスターは、多段階のアフィニティとトポロジー認識スケジューリング設計を採用し、HPNネットワークに基づいて10万基のカードの安定した相互接続をサポートする。多段階で拡張可能なアーキテクチャにより、各カード間の相互接続パスはより短く、帯域幅はより優れている。霊駿クラスターはタスク指向の安定性設計と分単位での障害回復能力を備え、モデル訓練タスクのクラスター安定性を効果的に向上させている。

AI需要の急増は汎用計算能力の需要上昇も牽引しており、アリクラウドの汎用計算は全面アップグレードされた。独自開発の「飛天+CIPU」アーキテクチャ体系に基づき、アリクラウドの第9世代エンタープライズ向けインスタンスはインテル、AMDの最新チップを採用し、計算能力レベルを大幅に向上させるだけでなく、エージェントに安定、安全、高性能な汎用CPU計算能力を提供する。その中でも、第9世代AMDインスタンス「g9ae」は物理コア仕様を提供し、性能は最大67%向上し、特に企業のオフラインデータ分析処理、動画トランスコーディングなどの高同時実行性が要求されるシナリオに適している。

AI負荷向けに弾力性・スケジューリング最適化・大規模運用を実現するコンテナコンピューティングも大幅アップグレード。コンテナサービス「ACK」は霊駿ノードプールを新設し、モデル認識インテリジェントルーティング、マルチロール推論負荷管理、障害自己修復などの核心機能を導入し、自動処理回復時間を85%短縮、モデル推論のコールドスタート速度を10倍に高速化した。コンテナ計算サービス「ACS」はネットワークトポロジー認識スケジューリングを強化し、タスク通信性能を全体で30%向上させた。さらにAIエージェントシナリオ向けに深度最適化され、Serverless GPU計算能力は箱から出してすぐに使用可能で、毎分15000サンドボックスという大規模同時実行弹性をサポートする。セキュリティサンドボックス、インテリジェントスリープとウェイクアップと組み合わせ、エージェントのオンデマンド起動と効率的な応答を実現する。

アリクラウドの人工知能プラットフォーム「PAI」と「通義」大規模モデルは連携して最適化が進められ、フルスタックAIによる「相乗効果(1+1>2)」を実証している。訓練層では、MoEモデルに対して、統一スケジューリング機制、適応型計算通信隠蔽、EP計算負荷均衡、計算とメモリの分離並列などの最適化手法を採用し、通義千問モデルの訓練におけるエンドツーエンドの高速化比を3倍以上向上させた。DiTモデル訓練エンジンをアップグレードし、通義万相の単一サンプル訓練所要時間を28.1%低減した。推論層では、大規模EP、PD/AF分離、重み最適化、LLMインテリジェントルーティングを含む全リンクの最適化を通じて、推論効率を显著に向上させた。推論スループット(TPS)は71%増加、レイテンシー(TPOT)は70.6%低減、スケールアウト時間は97.6%低減した。

「アリクラウドは現在、最先端のAIインフラストラクチャと最先端のモデルの両方を兼ね備えた、全く新しいAIスーパーコンピューターの構築に全力を注いでいる。これら二つは製品設計と運用アーキテクチャで高度に連携することが可能であり、アリクラウド上で通義千問モデルを呼び出し、訓練する際に最高の効率を達成することを保証する」と呉泳銘氏は述べた。

現在までに、アリクラウドは中国第1位、世界トップクラスのAIインフラストラクチャとクラウドコンピューティングネットワークを運営しており、世界29のリージョンに90のアベイラビリティーゾーンを有する。調査会社Omdiaの2025年上半期データによると、中国のAIクラウド市場におけるアリクラウドのシェアは35.8%で、2位から4位までの合計を上回っている。生成AIを導入したフォーチュン中国500社企業のうち、53%超がアリクラウドを選択しており、浸透率は第1位となっている。今後3年間で、アリババはクラウドおよびAIインフラストラクチャ建設に3800億元を投じる計画であり、その総額は過去10年間の合計を上回る。

(為替換算レート:1人民元=20円で計算)

(原文:https://www.icsmart.cn/96705/)